YouTubeで解説動画あげるときに使えるなと思い。

ブログとかでもよくある、なんかキャラから吹き出しが出ているアレにも使えそう(露骨なアフィブログっぽくなるのでやらないが)

ということで、完全にズブのAI素人が画像生成AI(Stable Diffusion)をインストールして画像生成するまで。

以下のように、課題は多少あるがそれっぽいものは生成された。

本当にそれっぽいものがあっという間に生成されてびっくりした。

導入まで

以下のサイト様を参考にStable Diffusionを導入。ブラウザ上でなく、ローカル上で環境を構築する。

ローカルでの生成環境を構築したほうが、ブラウザ上で生成するより処理が早かったり制限がなさそうと思い環境構築。

基本、参考サイト様のところで記載されている通り。

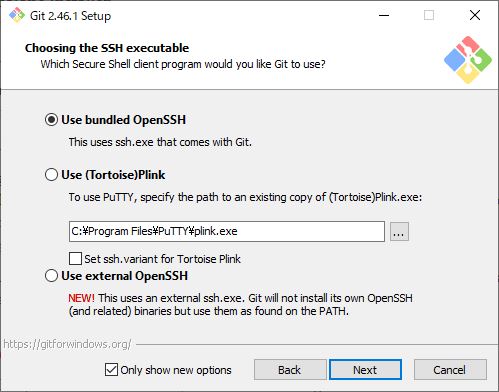

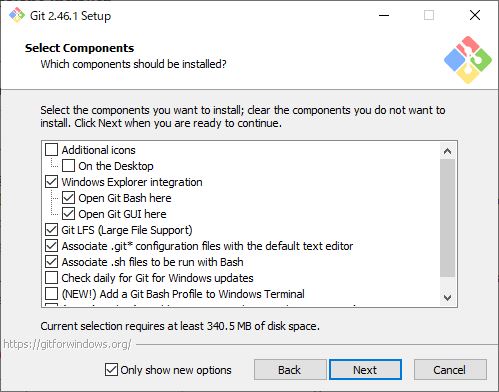

gitのインストールは以下のようにデフォルトでOK。

Stable Diffusionのbatファイルが起動しない件については、よくあるあるのPythonのpathが通っていない問題だった。Couldn’t launch pythonのメッセージが出る場合がこれ。

こちらのサイトで、起動しないのはpathが通ってないからと発覚。

ということでパスを通す。コマンドプロンプトを立ち上げpip -Vで出力されたものを、from以降の文字列を全部コピペしてwebui-user.batのset PYTHON=に貼り付けて保存。

これでwebui-user.batも無事起動。

実際に生成してみて

生成したもの一覧

まず実際に生成したもの一覧。

立ち絵に使えそうな感じのものはできている気がする。

よく見るとあやしい部分はあるが、立ち絵に使うようなデフォルメイラストならなんとかごまかせている感がある。手とか。

出力速度とPCスペック

出力イラストは自分のスペックだと1枚20秒ほど。早い。

実際にイラスト描いたときと比べたら何十倍レベルの速度で生成される。

PCのスペックは以下の通り。

OS:Windows 10 Pro

CPU:Intel(R) Core(TM) i7-6700 CPU @ 3.40GHz

メモリ:32GB(DDR4_8GBx4)

GPU:NVIDIA GeForce GTX 970

当時はハイエンド寄りとはいえ、組んだのが10年近く前のデスクトップPCだったためいろいろと不安だったが、それでも1枚20秒の生成速度を叩き出せた。

ご覧の通りWindows11にアップデートできないCPUを積んでいるくらい古いPCなので、いろいろと心配だった。

また、GPUを積んでいるのもよかったのかもしれない。同型のGPUが2024年現在だと6,500円だったが、無いよりは全然マシといった感じか(組んだときは40,000円くらいした気がしたんだけど……)

出力設定

モデルはAnime-CHIBI4.5を採用。

プロンプト(呪文)は以下を必須で入れた。

1girl,cute,chibi,full body,white background,simple background

1人の女の子の全身を生成するため、1girlとfull bodyを記述。

そしてデフォルメキャラ生成のためcuteとchibiを入れる。chibiがデフォルメキャラ生成の重要ワードっぽい。

何も指定しないと背景絵も勝手に生成されるため、white backgroundとsimple backgroundを入れる。

ネガティブプロンプトは以下の通り。

worst quality,ugly,bad anatomy,jpeg artifacts,cat ears

上位の4つは、どこかのサイトでデフォルトで入れるべきと書いていたようなもの。いくつかのサイトで共通で似たようなワードを入れていた。

これをいれるだけでエラーが減るとか。

あとなぜかネコ耳娘ばかり生成されるので、cat earsをネガティブプロンプトに入れておいた。

ツインテールとかも自動生成されやすいので、状況によってはtwintailsを入れたり、とか。

課題とか

出力されたものをそのまま立ち絵として使うのに、致命的なものではないが若干の課題も感じる。

まず一番思ったのは頭身。

生成される画像の絵柄はまあまあ似たりよったりだが、頭身が3~5頭身位で安定しない。

解説動画で複数のキャラが出てくるが、それぞれの頭身が違えば違和感しか感じない。

頭身の指定ができないかを考えねばならない。

また、背景を白一色にしたいがなかなかうまくいかず、謎の背景が追加されることも

特に文字系は本当に謎文字になる。

あと、以下のように髪を持ったりと乗っていたりと、そういった謎画像が生成されることも。

変な絵と背景は、何度か出力してそれが出なかったものを採用すればいい気がするが、頭身は指定できないか模索中。

といった感じで、案外簡単にAIでの立ち絵イラストの出力ができた。

課題になっている頭身の指定と、表情差分絵とか作れれば、解説動画やブログで満足に使えるものになりそう。

コメント